في الوقت القصير منذ إنشائها ، اكتسبت ChatGPT وغيرها من منصات الذكاء الاصطناعي التوليدية سمعة معززات الإنتاجية النهائية. ومع ذلك ، فإن التكنولوجيا نفسها التي تتيح الإنتاج السريع لنصوص عالية الجودة عند الطلب ، يمكنها في نفس الوقت الكشف عن بيانات الشركة الحساسة. حادثة وقعت مؤخرا، حيث قام مهندسو برمجيات سامسونج بلصق رمز الملكية في ChatGPT ، يوضح بوضوح أن هذه الأداة يمكن أن تصبح بسهولة قناة تسرب بيانات محتملة. تقدم هذه الثغرة الأمنية تحديًا صعبًا لأصحاب المصلحة الأمنيين ، حيث لا يمكن لأي من أدوات حماية البيانات الحالية ضمان عدم تعرض أي بيانات حساسة لـ ChatGPT. في هذه المقالة سوف نستكشف تحدي الأمان هذا بالتفصيل ونبين كيف يمكن أن توفر حلول أمان المتصفح حلاً. كل ذلك مع تمكين المؤسسات من تحقيق إمكانات إنتاجية ChatGPT بالكامل ودون الحاجة إلى المساومة على أمان البيانات.

النقطة العمياء لحماية بيانات ChatGPT: كيف يمكنك التحكم في إدخال النص في المتصفح؟عندما يقوم الموظف بلصق نص أو كتابته في ChatGPT ، لم يعد يتم التحكم في النص بواسطة أدوات وسياسات حماية البيانات الخاصة بالشركة. لا يهم إذا تم نسخ النص من ملف بيانات تقليدي أو مستند عبر الإنترنت أو مصدر آخر. هذه ، في الواقع ، هي المشكلة. حلول منع تسرب البيانات (DLP) - من الوكلاء المحليين إلى CASB - كلها موجهة نحو الملفات . إنهم يطبقون السياسات على الملفات بناءً على محتواها ، مع منع الإجراءات مثل التعديل والتنزيل والمشاركة والمزيد. ومع ذلك ، فإن هذه الإمكانية قليلة الفائدة لحماية بيانات ChatGPT. لا توجد ملفات مشتركة في ChatGPT. بدلاً من ذلك ، يتضمن الاستخدام لصق مقتطفات نصية منسوخة أو الكتابة مباشرةً في صفحة ويب ، وهو أمر خارج عن إدارة أي منتج لمنع فقدان البيانات (DLP) والتحكم فيه.

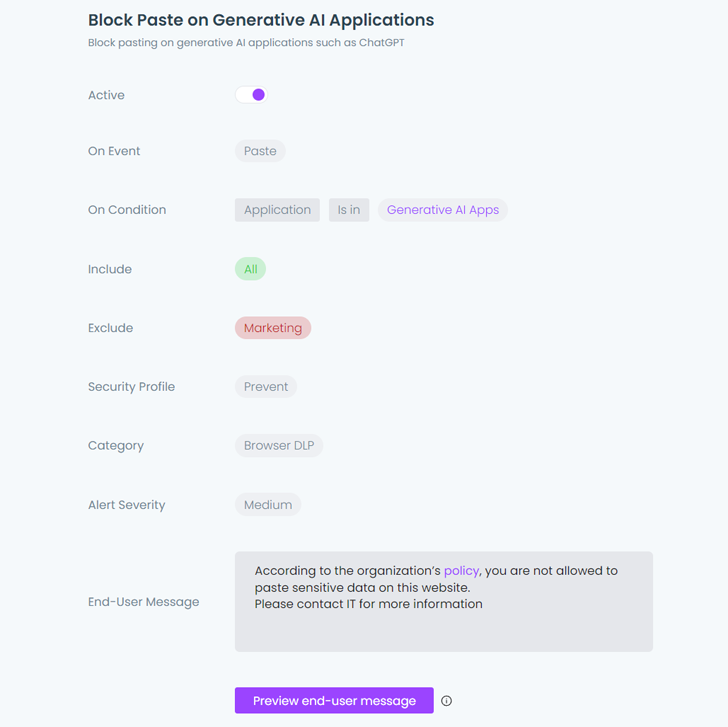

كيف تمنع حلول أمان المتصفح الاستخدام غير الآمن للبيانات في ChatGPTأطلقت LayerX منصة أمان المتصفح الخاصة بها للمراقبة المستمرة وتحليل المخاطر والحماية في الوقت الفعلي لجلسات المتصفح. يتم تسليم LayerX كملحق للمتصفح ، وهو يتمتع برؤية دقيقة في كل حدث يقع داخل الجلسة. يتيح ذلك لـ LayerX اكتشاف السلوك المحفوف بالمخاطر وتكوين السياسات لمنع تنفيذ الإجراءات المحددة مسبقًا.

لتمكين هذه الإمكانية ، يجب على فرق الأمان التي تستخدم LayerX تحديد العبارات أو التعبيرات العادية التي يريدون حمايتها من التعرض. بعد ذلك ، يحتاجون إلى إنشاء سياسة LayerX التي يتم تشغيلها كلما كان هناك تطابق مع هذه السلاسل.

انظر كيف يبدو في العمل:

الاختلاف الذي يجعل LayerX الحل الوحيد الذي يمكنه معالجة فجوة حماية بيانات ChatGPT بشكل فعال هو وضعه في المتصفح نفسه ، مع إمكانية الرؤية في الوقت الفعلي وتنفيذ السياسة على جلسة المتصفح الفعلية. يجعل هذا النهج أيضًا حلاً مثاليًا للحماية من أي تهديد إلكتروني يستهدف البيانات أو نشاط المستخدم في المتصفح ، كما هو الحال مع تطبيقات SaaS.

يتفاعل المستخدمون مع تطبيقات SaaS من خلال متصفحاتهم. هذا يجعل من السهل على LayerX حماية كل من البيانات داخل هذه التطبيقات وكذلك التطبيقات نفسها. يتم تحقيق ذلك من خلال فرض الأنواع التالية من السياسات على أنشطة المستخدمين خلال جلسات الويب:

سياسات حماية البيانات: بالإضافة إلى الحماية القياسية الموجهة للملفات (منع النسخ / المشاركة / التنزيل / إلخ) ، توفر LayerX نفس الحماية الدقيقة التي توفرها لـ ChatGPT. في الواقع ، بمجرد أن تحدد المنظمة المدخلات التي تحظر لصقها ، يمكن توسيع نفس السياسات لمنع تعريض هذه البيانات لأي موقع ويب أو SaaS.

تخفيف اختراق الحساب : تراقب LayerX أنشطة كل مستخدم على تطبيقات SaaS الخاصة بالمؤسسة. سيكتشف النظام الأساسي أي سلوك غير طبيعي أو تفاعل بيانات يشير إلى تعرض حساب المستخدم للاختراق. ستؤدي سياسات LayerX بعد ذلك إما إلى إنهاء الجلسة أو تعطيل أي قدرات تفاعل مع البيانات للمستخدم في التطبيق.